28

Veri kalitesi, bir veri deposunda biriken veri parçalarının

veya kümelerinin doğruluk derecesini, standartlara

uygunluğunu, tekilleştirilebilirliğini, bütünlüğünü, veriler

arasındaki ilişkilerin doğru tanımlanma seviyesini ifade

eden kavramdır. Hatalı üretime açık veri girişleri, veriyi

toplarken yazılım kontrol noktalarının eksik veya yanlış

kodlanması, veriler arasındaki ilişkilerin hatalı veya

eksik olarak tanımlanması ve kurulması, modellerin

gerçeğe aykırı olarak kurgulanması veri kalitesizliğinin

temel sebeplerindendir. Yasal kısıtlar veya operasyonel

süreçlerdeki zorunlu kabuller de veri kalitesizliğine yol açan

önemli etkenlerdendir.

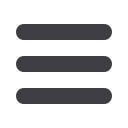

Kurumlarda veri kalitesi ölçümü için kullanılan başlıca

yöntemlerden biri olan profilleme, veri yapılarındaki her

kolon ve tablo için boşluk/doluluk, default değer, kopya

veri ve desen frekans analizleri ile yapılan bir resimleme

çalışmasıdır. Örneğin, adres kolonun %80 boş olması, araç

plaka verisindeki farklı desenler vb. gibi.

Basit İstatistikler

/

Simple Statistics

• Boş Sayısı

/ Number of empty cells

• Default Değer Sayısı

/ Number of Default values

• Distinct Sayısı

/ Number of Distinct values

• Duplicate Sayısı

/ Number of Duplicate values

• Null Sayısı

/ Number of Null values

• Toplam Satır Sayısı

/ Total number of rows

• Unique Sayısı

/ Number of Unique values

• Desen Frekans Analizi (Yüksek-Düşük)

/ Design

Frequency Analysis (High-Low)

• Desen low frequency table

/ Design low frequency

table

• Tarih desenleri

/ History data design

İş kurallarının oluşturulması ve incelenmesi bir başka veri

kalitesi araştırma yöntemidir. İncelenen her bir kolon için

o kolonda tutulacak verinin hangi iş kurallarına dayanması

gerektiği çıkarılır. Örneğin şasi alanının otomobil araç

grubunda 17 karakter olması, plaka kodunun ilk üç

karakterinin numerik olması vb. gibi.

Veri kalitesi çalışmalarında mantıksal ilişkilerin denetimi de

Data quality describes the level of accuracy, compatibility

with standards, singularisability, integrity of data pieces or

clusters collected in a data warehouse as well as the level

of accuracy of the description of relations between data.

Among the major reasons of low-quality data are data entry

vulnerable to incorrect production, incorrect or missing

coding of software check points during the process of data

collection, incorrect or missing definition or configuration

of relations between data, and unrealistic configuration of

models. Legal limitations and mandatory acceptances in

operational processes are other important factors that cause

low data quality.

Profiling, which is one of the major tools used for measuring

data quality in organizations, is a RESIMLEME CALISMASI

done using emptiness/fullness analysis for every column and

table in data structures, default value analysis, copy data

analysis and design frequency analysis. For example, the

address column being 80% empty, different designs of vehicle

license plate data etc.

Text İstatistikleri

/

Text Statistics

• Maksimum Uzunluk

/ Maximum Length

• Minimum Uzunluk

/ Minimum Length

• Ortalama Uzunluk

/ Average Length

Özet İstatistikler

/

Special Statistics

• Ortalama Değer

/ Average Value

• Median Değeri

/ Median Value

• Aralıklara Göre Dağılım

/ Interval-based distribution

Creation and analysis of work rules is a separate data quality

research method. For every column analyzed, the goal is to

find out which work rules should be taken as basis for the

data to be held in that column. For example, chassis field

in the car group being 17 characters long or the first three

characters of the license plate code being numeric values.

SBM’de Verİ Kalİtesİ Çalışmaları

Data Quality Works at SBM

SBM’DEN

FROM SBM